深層学習

深層学習 【深層学習】ハルシネーションについて学ぼう

本記事ではハルシネーションについて説明しています。ハルシネーションは、人工知能が事実に基づかない情報を生成する現象です。これらのハルシネーションが発生する原因は、主にデータの質にあります。ファクトチェックの強化や学習データの質の向上など求められます。

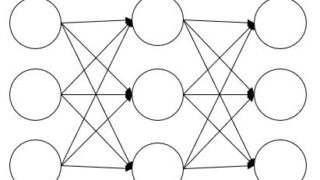

深層学習

深層学習  深層学習

深層学習  深層学習

深層学習  深層学習

深層学習  深層学習

深層学習  深層学習

深層学習  機械学習

機械学習